Что такое RAG и почему вокруг него такой хайп

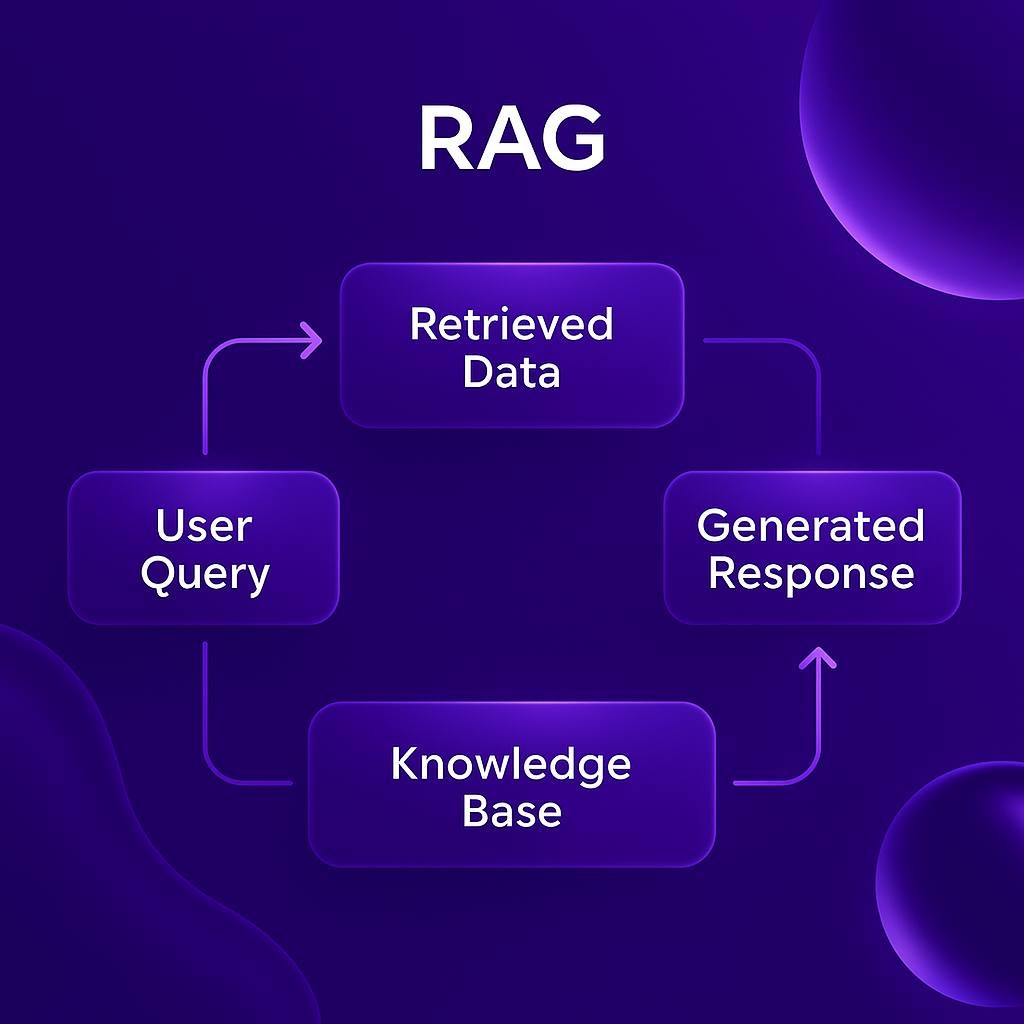

RAG (Retrieval-Augmented Generation) — это архитектура, которая заставляет большие языковые модели работать умнее, точнее и предсказуемее.

По сути — это способ “дать модели память”, которую она не выдумывает, а подтягивает из проверенных источников.

Грубо упрощая, RAG = LLM (которая красиво формулирует мысли) + Поисковик по вашей внутренней базе знаний.

Эта схема решает главный минус LLM — галлюцинации. Когда модель “ответила уверенно, но неправильно”.

RAG не дает ей этого сделать — сначала он ищет факты, и только потом формирует ответ.

Почему классические чат-боты устарели

Раньше чат-боты были:

– глупыми,

– шаблонными,

– ограниченными заранее прописанными сценариями.

RAG превращает корпоративного бота в инструмент уровня:

– «дай краткую сводку по документации»

– «опиши баг, основываясь на логах»

– «подготовь ТЗ из этих 20 страниц текста»

– «собери ответы сотрудников в один отчет»

И он действительно это делает. Не понимает заранее, как, но делает — потому что архитектура даёт ему доступ к контексту, которого раньше не было.

Где RAG особенно силён

1. Поддержка и helpdesk

Бот перестаёт быть формальностью.

Он начинает разбираться в инфраструктуре компании лучше новичка из отдела.

2. Внутренние порталы и вики

Документацию больше не нужно искать вручную — боту можно задать вопрос человеческим языком.

3. Обучение персонала

RAG идеально обучает сотрудников по внутренним материалам, а не по учебникам “в вакууме”.

4. Автоматизация офисной рутины

Отчёты, сводки, протоколы, анализ обсуждений — всё это RAG делает быстрее человека.

Почему именно сейчас — момент RAG

Потому что впервые сошлись три вещи:

1. Модели стали достаточно мощными.

Можно строить RAG поверх локальных моделей (Qwen, Llama), не отдавая данные в облако.

2. Эмбеддинги наконец-то стали качественными.

Поиск по смыслу стал работать почти как человеческая логика.

3. Появились сервисы, которые снимают боль разработки.

RAG перестал быть “для исследователей”, его можно внедрять в реальную компанию без PhD в команде.